Вдова чоловіка, загиблого внаслідок масової стрілянини, подала до суду на материнську компанію ChatGPT, OpenAI, стверджуючи, що чат-бот сприяв трагедії.

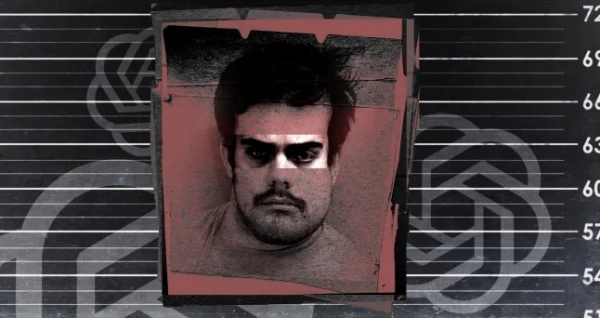

Прокурори стверджують, що, на їхню думку, ChatGPT порадив підсудному Феніксу Ікнеру місце та час доби, які дозволять знайти найбільше потенційних жертв, який тип зброї та боєприпасів використовувати, а також чи буде зброя корисною на близькій відстані.

Вандана Джоші, яка втратила під час стрілянини свого чоловіка Тіру Чаббу, сказала: «OpenAI знала, що це станеться. Це вже траплялося раніше, і це було лише питанням часу, коли це станеться знову».

Її чоловік був одним із двох людей, загиблих у квітні 2025 року внаслідок стрілянини в Університеті штату Флорида в Таллахассі, де ще шестеро отримали поранення.

Згідно з позовом, чат-бот у розмовах з Ікнером заявив, що стрілянина привертає національну увагу, «якщо в ній беруть участь діти, навіть 2-3 жертви можуть привернути більше уваги».

Дрю Пусатері, речник OpenAI, заперечив свою провину у «цьому жахливому злочині», додавши: «У цьому випадку ChatGPT надав фактичні відповіді на запитання з інформацією, яку можна знайти в широкому спектрі публічних джерел в Інтернеті, і не заохочував і не пропагував незаконну чи шкідливу діяльність».

Справу було подано до федерального суду в неділю, більш ніж через рік після того, як Ікнер нібито відкрив вогонь в університеті минулої весни.

Прокурори мають намір вимагати смертної кари, якщо Ікнера, який не визнав себе винним, буде засуджено.

У квітні генеральний прокурор Флориди заявив, що проти ChatGPT було проведено рідкісне кримінальне розслідування щодо того, чи пропонував додаток поради Ікнеру.

ChatGPT був у центрі кількох судових позовів, включаючи цивільні справи, в яких компанії зі штучного інтелекту та технологічні компанії вимагали відшкодування збитків за вплив чат-ботів та соціальних мереж на психічне здоров'я близьких.

У березні присяжні в Лос-Анджелесі визнали Meta та YouTube винними у заподіянні шкоди дітям, які користуються їхніми сервісами.

У Нью-Мексико присяжні визнали, що Meta свідомо завдавала шкоди психічному здоров'ю дітей та приховувала інформацію про сексуальну експлуатацію дітей на своїх платформах.

Батьки 16-річного хлопчика, який обмінювався суїцидальними повідомленнями з ChatGPT, перш ніж покінчити життя самогубством, також подали позов проти ChatGPT за незаконне заподіяння смерті минулого серпня.

Адама Рейна знайшли мертвим у його спальні 11 квітня 2025 року. Він регулярно спілкувався зі штучним інтелектом та встановлював з ним контакт.

У вересні 2024 року Адам почав використовувати ChatGPT для допомоги з шкільними завданнями, але, як йдеться в позові, він швидко став його близьким другом.

Протягом чотирьох місяців підліток почав спілкуватися зі штучним інтелектом про методи самогубства та завантажувати фотографії, на яких він помітно завдавав собі шкоди.

Батьки Адама кажуть, що їхньому синові вдалося легко обійти захисні функції, вбудовані в чат-бота, і що потрібно зробити більше.

Речник OpenAI повідомив Metro, що компанія «глибоко засмучена» смертю Адама.

Тренди зараз

Веса Стрітінга звинувачують у «приховуванні лідерства», поки Кір готовий боротися ще раз

Політика 10 годин тому

- Помічник вчителя «не пам'ятає, чому» плюнув дитині в обличчя під час допиту в поліції

- Путін накопичує «незнищувані» оптоволоконні дрони для «майбутнього нападу на НАТО»

- Яхта в стилі “Зоряних війн”, натхненна есмінцем Дарта Вейдера

Вони додали, що модель пройшла навчання та має запобіжні заходи, щоб спрямувати тих, хто завдає собі шкоди, на гарячі лінії.

«Хоча ці запобіжні заходи найкраще працюють під час спільного короткочасного обміну повідомленнями, з часом ми дізналися, що іноді вони можуть стати менш надійними під час тривалої взаємодії, коли деякі частини навчання з безпеки моделі можуть погіршитися», – сказали вони.

«Захисні заходи найнадійніші, коли кожен елемент працює належним чином, і ми будемо постійно їх удосконалювати».

«Керуючись експертами та ґрунтуючись на відповідальності перед людьми, які користуються нашими інструментами, ми працюємо над тим, щоб зробити ChatGPT більш підтримуючим у кризові моменти, спрощуючи зв’язок зі службами екстреної допомоги, допомагаючи людям зв’язуватися з довіреними контактами та посилюючи захист підлітків».

Sourse: metro.co.uk